El Parlamento Europeo marca un hito con la aprobación de la primera ley de inteligencia artificial del mundo

El Parlamento Europeo aprueba una legislación histórica para regular la IA, garantizando la seguridad y los derechos de los ciudadanos en un entorno digital en evolución constante.

Cámarabilbao

El Parlamento Europeo ha dado un paso histórico al aprobar la primera ley integral de regulación de la inteligencia artificial (IA) en el mundo que permitirá o prohibirá su uso en función del riesgo que suponga para los ciudadanos. La nueva legislación comunitaria, que deberá ser refrendada por el Consejo de la Unión Europea, busca establecer un marco ético y legal que garantice la seguridad y los derechos de los ciudadanos europeos en un entorno donde la IA tiene un peso cada vez mayor. Se prevé que, tras su aprobación, entre en vigor en el año 2026.

La Comisión Europea ha destacado que esta ley es crucial para proteger los valores fundamentales de la Unión Europea, como la privacidad, la igualdad y la dignidad humana, al tiempo que fomenta la innovación responsable en el ámbito de la inteligencia artificial. La aprobación de esta legislación ha sido recibida con elogios tanto a nivel nacional como internacional, destacando su importancia para sentar un precedente global en la regulación de la IA y para garantizar un desarrollo tecnológico que beneficie a la sociedad en su conjunto.

¿Qué regula la ley de inteligencia artificial europea?

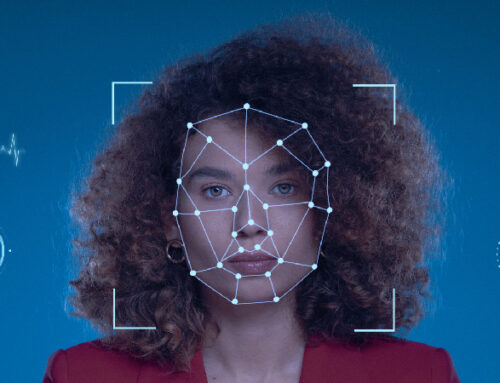

Entre las principales disposiciones de la ley se encuentran la prohibición de sistemas de IA considerados de alto riesgo, como aquellos que manipulan el comportamiento humano de manera inaceptable o que tienen un impacto significativo en la seguridad pública. La ley prohibirá la vigilancia masiva en espacios públicos, pero permitiendo que las fuerzas del orden puedan emplear las cámaras de identificación biométrica, con previa autorización judicial, para prevenir una amenaza terrorista inminente. También para localizar o identificar a una persona que haya cometido delitos de terrorismo, tráfico de personas, explotación sexual o, por ejemplo un crimen medioambiental, así como para buscar a las víctimas de estos delitos.

Además, se identifica toda una serie de aplicaciones de inteligencia artificial de alto riesgo que solo se podrán comercializar si sus desarrolladores garantizan que respetan los derechos fundamentales. Por ejemplo, los que puedan influir en el resultado de unas elecciones o los que empleen las entidades financieras para evaluar la solvencia y la calificación crediticia de los clientes.

La regulación también aborda la necesidad de supervisión y control adecuados, estableciendo mecanismos de certificación y evaluación de conformidad para los sistemas de IA, así como la creación de autoridades nacionales competentes en la materia.